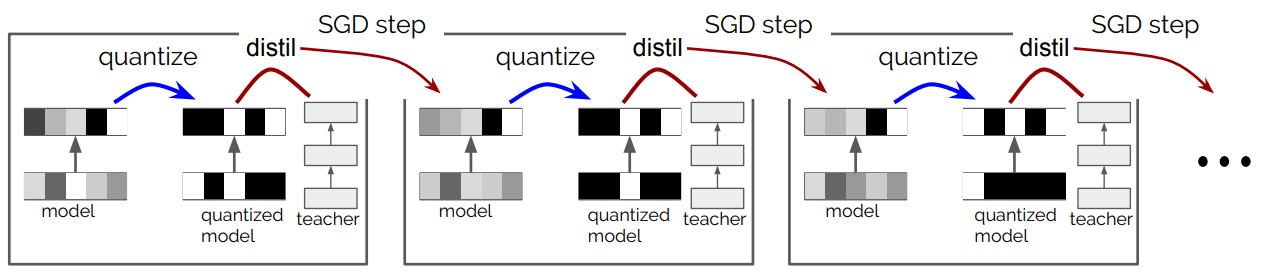

Paper Link : https://arxiv.org/abs/1802.05668 Github : https://github.com/antspy/quantized_distillation 스터디에서 발표했다. Quantized Knowledge Distillation 관한 내용이었는데, 관련 배경지식이 많이 부족해서 힘들었다. KD는 심플하게 Teacher Network의 soft label로 Student Network를 training 시키는 것으로 알고 있다. 이 과정이 Knowledge Transfer이고 이때 생기는 loss를 Distillation Loss라고 한다. 그런데 Quantization을 공부한다면 다음과 같은 생각을 해볼 수 있을 것이다. 적정 Criteria에 따라서 student..